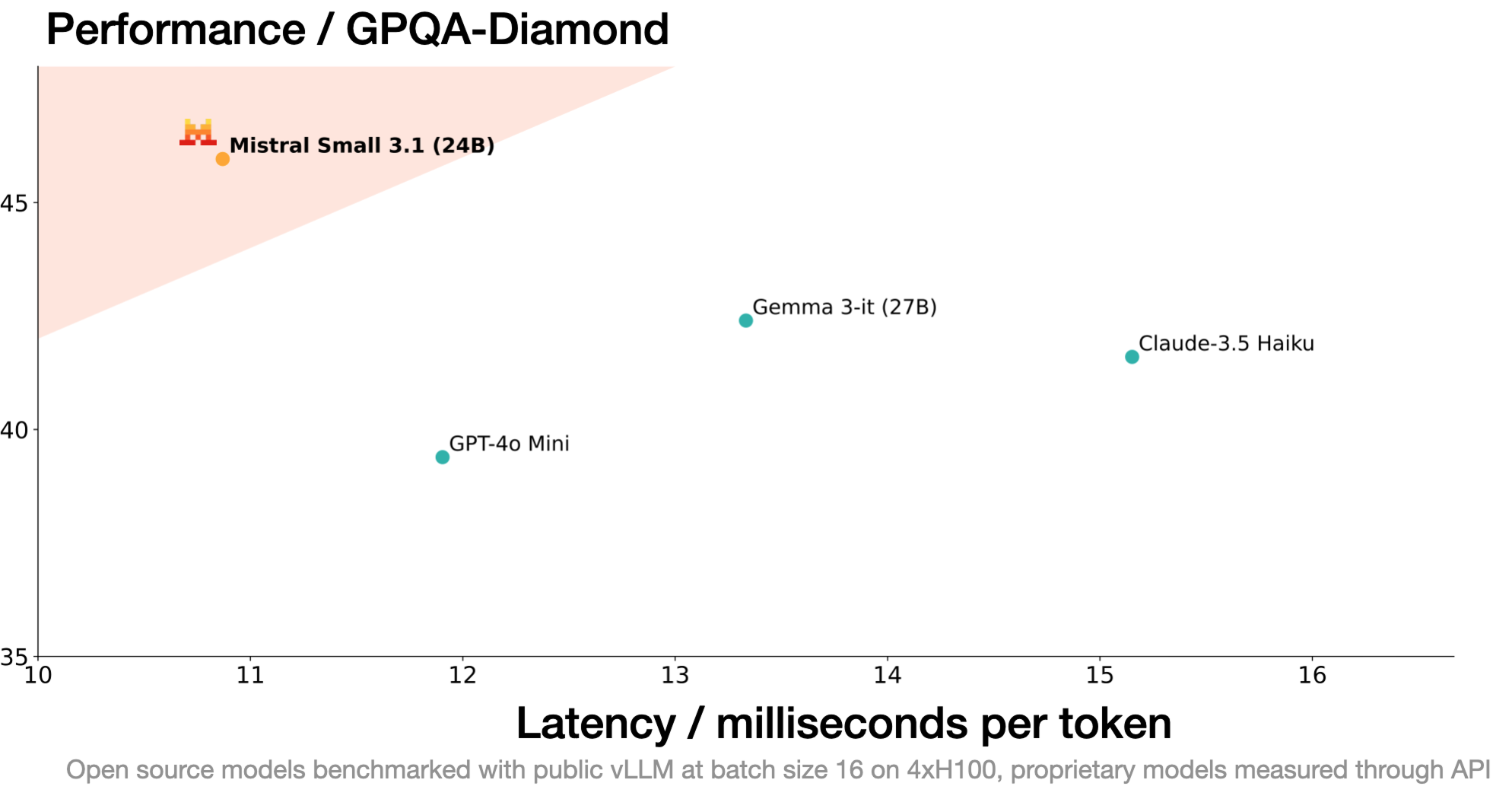

Selon Mistral AI, Small 3.1 surpasserait les performances des modèles concurrents comparables.

Mistral AI a introduit un nouveau modèle léger dénommé Mistral Small 3.1. Small 3.1 est open-source et donc très accessible. Le modèle d’IA peut traiter du texte et des images avec seulement 24 milliards de paramètres. C’est une fraction de la taille des modèles les plus avancés sur le marché.

Open-source

Dans un blog, Mistral explique que Small 3.1, comparé à son prédécesseur Small 3, offre « des performances textuelles améliorées, une compréhension multimodale et un nombre étendu de tokens (128 000) ». De plus, il peut traiter des données à 150 tokens par seconde. Cette impressionnante performance technique est due à la stratégie alternative adoptée par Mistral. L’accent est mis sur les améliorations algorithmiques et l’optimisation de l’entraînement, plutôt que sur l’utilisation d’un nombre toujours croissant de GPU pour les nouveaux modèles.

Le fait que Mistral rende ses modèles open-source prouve à nouveau que l’entreprise souhaite rendre l’IA accessible et ne choisit pas des modèles fermés comme ceux d’OpenAI. Elle bénéficie simultanément des possibilités de recherche et de développement de la large communauté de l’IA. Cela porte ses fruits, car avec une valeur de 5,5 milliards d’euros, elle peut se considérer comme la principale entreprise d’IA en Europe.

Mistral 3.1 est téléchargeable via Huggingface, via l’API AI de Mistral ou sur la plateforme Vertex AI de Google. En plus de Small 3.1, l’entreprise a récemment lancé Mistral Large 2, Pixtral et Codestral.

lire aussi