Microsoft élargit sa famille Phi avec un nouveau modèle, Phi-4. Ce petit modèle de langage est censé être adapté aux problèmes mathématiques et compte 14 milliards de paramètres.

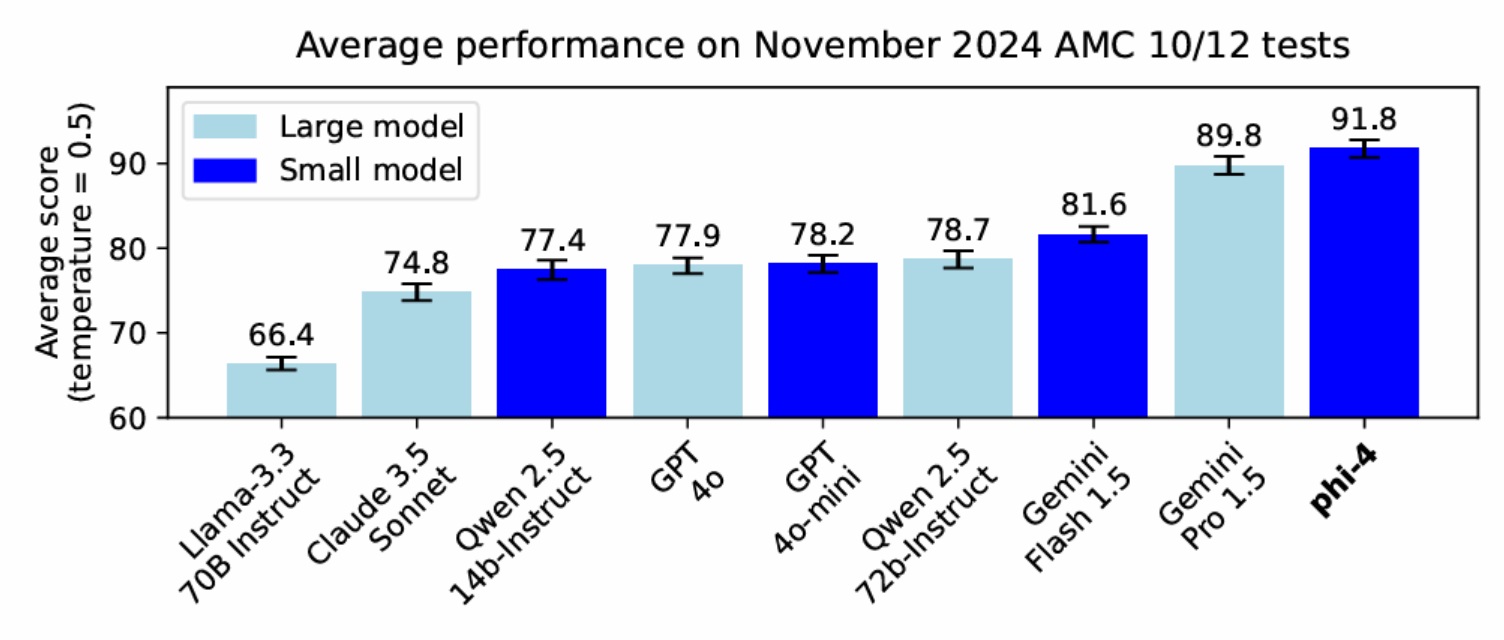

Le dernier modèle de langage de la famille Phi est connu : Phi-4. Ce petit modèle de langage excelle dans les tâches de raisonnement complexes telles que les problèmes mathématiques, selon un billet de blog de Microsoft. Le modèle est entraîné sur des « ensembles de données synthétiques de haute qualité » et ses performances seraient même supérieures à celles de modèles tels que Llama, GPT-4o ou Gemini Pro 1.5. Phi-4 est disponible sur Azure AI Foundry.

Raisonnement mathématique

Le nouveau modèle de langage Phi-4 de Microsoft succède à Phi-3-mini, qui ne comportait que 3,8 milliards de paramètres. Pour Phi-4, Microsoft a augmenté le nombre de paramètres à 14 milliards. Le modèle est censé exceller principalement dans la résolution de problèmes mathématiques et obtenir de meilleurs résultats que d’autres modèles linguistiques, notamment Llama, GPT-4o et même Gemini Pro 1.5 ou Claude 3.5 Sonnet.

« Phi-4 surpasse des modèles comparables et plus grands dans le raisonnement mathématique grâce à des avancées dans les processus, y compris l’utilisation d’ensembles de données synthétiques de haute qualité, la curation de données organiques de haute qualité et les innovations post-entraînement. Phi-4 continue de repousser les limites de la taille par rapport à la qualité », a déclaré Microsoft. L’entreprise ne révèle pas plus de détails que le fait qu’il a été formé sur des « ensembles de données synthétiques de haute qualité ». Le modèle est disponible sur Azure AI Foundry.

lire aussi